ローカルLLMはまず小さめモデルから:Ollamaで始める導入〜疎通確認

※この記事は macOS(Mac)でのローカル検証を想定します。コマンドや挙動は Ollama のバージョンで変わる可能性があるため、実行前に ollama --help を確認してください。(要出典: Ollama公式CLI)

TL;DR

まずはモデルサイズが小さいものから始めて「起動→1回応答」まで通し、用途に合わせて段階的にモデルを変えるのが安全です。モデルが大きいほど、メモリ/ディスク消費と処理時間が増えやすくなります。

先に結論:最初は“小さめモデルで1回応答”まで通す

結論:最初にやることは「小さめのモデルで 1 回応答を返す」だけです。ここまで通れば、以降の問題は「モデル選定」か「性能/運用」のどちらかに寄せて切り分けできます。

なぜ小さめから始めるべきか(失敗要因が減る)

モデルが大きいほど、必要なメモリやディスク容量が増えます。その結果、初回のセットアップで発生しやすい問題(動作が遅い/メモリ不足/ディスク不足)が増えます。最初は “成功状態を作る” ことを優先してください。

この記事でできるようになること(到達点を明確化)

この順に進めます。

- Ollama を導入する

- モデルを取得する(まずは小さめ)

- CLI で 1 回応答を確認する

- 必要なら API(OpenAI 互換)でも疎通確認する

- モデル選定と運用上の注意を把握する

この記事の提供物(チェックリスト/早見表/curlテンプレ)

「再現しやすい」ことを優先して、次をコピペ用で用意します。

- インストール後チェックリスト(バージョン/ヘルプ/起動状態)

- モデル選定の早見表(用途×サイズ×必要リソース×体感)

- API 疎通確認テンプレ(curl 1 発)

Ollama とは何か:ローカルでLLMを動かすための入口

結論:Ollama は、ローカルで LLM を「取得して」「起動して」「呼び出す」までを短い手順で行うためのツールです。(要出典: Ollama公式)

どんな用途に向くか(検証/プロトタイピング)

次の用途に向きます。

- プロンプトの試行錯誤(要約/文章生成/アイデア出し)

- ローカル API でアプリ側の I/F を検証する(まず疎通、次に実装)

- 外部サービスに送らずに検証したい(ただし投入データの扱いは要判断)

向かないケース(重いモデル・低スペック等の注意)

次の条件では「セットアップはできても快適ではない」可能性が上がります。

- メモリに余裕がないのに、大きいモデルを前提にしている

- CPU 実行なのに GPU 実行の速度を期待している(体感の前提がズレる)

- 常時稼働を前提にしている(更新/ディスク管理/公開範囲の運用が必要)

インストール(Mac想定)と導入後の確認(チェックリスト付き)

結論:インストールしたら、まず「バージョン」「ヘルプ」「起動状態」を確認してください。ここを飛ばすと、後工程で詰まったときに原因が追えません。

インストール手順(Homebrew前提)※コマンドは公式で確認

手順(例):

- Homebrew がない場合は導入する (要出典: Homebrew公式)

- Ollama をインストールする

brew install ollama(要出典: Homebrew Formulae - ollama)

- インストール確認

ollama --version(要出典: Ollama公式CLI)

※Ollama は macOS アプリとして動作する形態もあります。インストール方法・起動方法は公式の案内に従ってください。(要出典: Ollama公式)

導入後の確認(バージョン/ヘルプ/起動状態)

- ヘルプを表示して、使えるサブコマンドを確認する

ollama --help(要出典: Ollama公式CLI)

- 起動状態を確認する(起動方式により異なる)

- CLI で起動するのか、アプリとして起動するのかを、公式と

--helpで確定する (要出典: Ollama公式)

- CLI で起動するのか、アプリとして起動するのかを、公式と

インストール後チェックリスト(コピペ用)

- [ ]

ollama --versionが表示できる (要出典: Ollama公式CLI) - [ ]

ollama --helpが表示できる (要出典: Ollama公式CLI) - [ ](任意)API を使う場合、ローカルの待受(例:

http://localhost:11434)に疎通できる (要出典: Ollama公式 OpenAI互換API)

最短で動かす:モデル取得→起動→1回応答

結論:「モデル取得 → 起動 → CLI で 1 回応答」の順で進めると、前提が少なく成功しやすいです。

モデルを選んで取得する(まずは小さめ)

最初は “小さめのモデル” を選んでください。ここで言う「小さめ」は、モデルサイズ(パラメータ数など)が比較的小さいもの、または軽い量子化のものです。どれが該当するかは公式の一覧で確認してください。(要出典: Ollama公式モデル一覧)

手順(例):

- モデルを取得する

ollama pull <model>(要出典: Ollama公式CLI)

起動(サーバー/常駐)と停止

起動方法は環境差が出やすいので、この記事では「自分の環境の正解」を --help と公式で確定する前提にします。(要出典: Ollama公式)

確認観点(ここだけ押さえる):

- 起動しているか(プロセス/メニューバー/待受ポートなど)

- 停止できるか(常駐を止められるか)

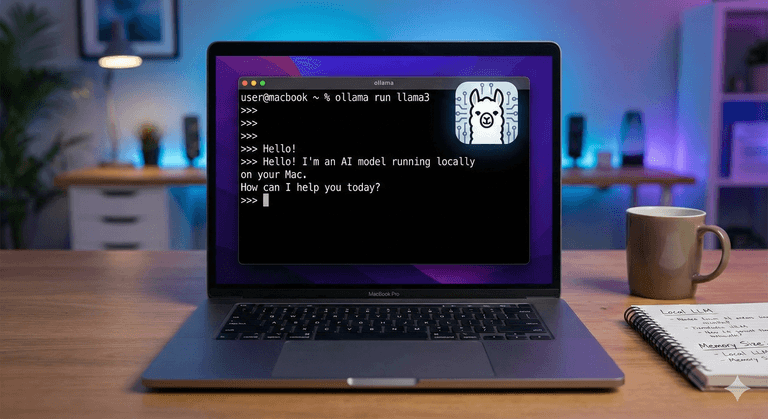

1回応答の確認(CLI で最短)

手順(例):

- モデルを実行してプロンプトを投げる

ollama run <model>(要出典: Ollama公式CLI)

- まずは短い入力で 1 回だけ応答を確認する(例:日本語で 1 行)

注意:

- 初回はモデル読み込みで時間がかかることがあります

- 応答が返れば、セットアップは成功と判断できます

モデルの選び方:用途×日本語×サイズ×快適さで決める

結論:モデル選定は「用途」と「快適に動くか(メモリ/速度/ディスク)」で決めます。品質だけで選ぶと、運用が破綻しやすくなります。

選定の観点(用途・品質・速度・コスト=リソース)

最低限、次の観点で判断します。

- 用途:雑談/要約/文章生成/コード支援など

- 言語:日本語の比重(日本語中心なら、まず日本語で短文テストする)

- 速度:対話の待ち時間を許容できるか

- リソース:メモリ/ディスク/発熱/バッテリー(ノートPC)

“大きいほど良い”ではない(トレードオフの整理)

一般に、モデルが大きいほど品質が上がりやすい一方、必要なメモリが増え、応答も遅くなりがちです。まずは “動くサイズ” を見つけ、用途に応じて段階的に変えてください。

マシンスペック別の選び方(断定せず目安)※要出典

ここは数値を断定せず、判断フローにします(数値を出す場合は出典必須)。

- 小さめのモデルで 1 回応答が返ることを確認する

- 遅い/重いなら、まずモデルサイズを下げる

- まだ厳しいなら、同時に動かすアプリを減らす

- それでも用途に耐えないなら、目的(速度/品質)に合わせて環境(より強いマシン/GPU 等)を検討する

(要出典: モデルサイズと必要メモリの一般的目安、各モデルの推奨要件)

よくある詰まりと切り分け(遅い/メモリ/取得失敗/ディスク肥大)

結論:詰まったら「症状 → 原因候補 → 対策の順序」で切り分けてください。順番を固定すると、原因が追いやすくなります。

体感が遅いとき(モデルサイズ/同時アプリ/期待値)

確認の順序:

- モデルサイズを下げる(最優先)

- 同時に動いているアプリを減らす(ブラウザ/IDE 等)

- CPU 実行の前提に期待値を合わせる(GPU 前提で比較しない)(要出典: CPU/GPU比較の一般論)

メモリ不足っぽいとき(症状と対策の順序)

症状例:

- 起動/読み込みで止まる、OS 全体が重くなる、他アプリが落ちる

対策の順序:

- モデルサイズを下げる

- 同時アプリを止める

- 常駐プロセスを減らす

- 必要なら「ローカルでやる範囲」を見直す(用途と品質の再調整)

モデル取得に失敗するとき(ネットワーク/容量)

確認ポイント:

- ネットワークが不安定でないか

- ディスク容量が足りているか(モデルはサイズが大きい)(要出典: モデルサイズの説明)

ディスクが増えるとき(一覧・削除・更新の運用)※コマンドは要確認

結論:モデルは増える前提なので、「一覧→不要削除→自分ルール」をセットで決めます。

- 現在のモデル一覧を見る(例:

ollama list)(要出典: Ollama公式CLI) - 不要なモデルを削除する(例:

ollama rm <model>)(要出典: Ollama公式CLI) - 検証用は軽量モデルに固定する、などの運用ルールを決める

API で疎通確認する(最小テンプレ)

結論:CLI で 1 回応答を確認できたら、次に API を “最小テンプレ” で疎通確認します。ここまで通れば、アプリ検証に進めます。

まずは curl 1発で確認する(成功判定の観点)

Ollama は OpenAI 互換 API を提供しています。(要出典: Ollama OpenAI compatibility)

手順(例):

- サーバーが起動している前提で、次を実行する

<model>はollama runで動作確認できたモデル名に置き換える

curl http://localhost:11434/v1/chat/completions \

-H "Content-Type: application/json" \

-d '{

"model": "<model>",

"messages": [{"role":"user","content":"テストです。1行で返して"}]

}'

(要出典: Ollama公式 OpenAI互換API)

成功判定の観点:

- HTTP が 200 系で返る

- レスポンスに出力が含まれる(例:

choices/message相当)(要出典: Ollama公式 OpenAI互換APIレスポンス形式)

OpenAI 互換 API を使う場面(アプリ検証に寄せる)

使いどころ:

- 既存の OpenAI クライアント/ツールを “ホスト差し替え” で動かしたい

- アプリ側の I/F(ストリーミング、ツール呼び出し等)を先に作りたい

うまくいかないときの観点(URL/ポート/バインド)※要出典

よく見るポイント:

localhost:11434に到達できるか(ポート・起動状態)(要出典: Ollama公式)- 別ホスト/別端末から叩く場合、バインド先や FW を閉じられているか(意図せぬ公開を避ける)(要出典: Ollama公式 or OSネットワーク設定)

API 仕様の参照先(公式)と、curlテンプレ(コピペ用)

公式で確認しておく項目(ここを押さえるとブレません):

- デフォルトのベースURL/ポート(例:

11434)(要出典: Ollama公式 OpenAI互換API) - 対応エンドポイント(例:

/v1/chat/completions)(要出典: Ollama公式 OpenAI互換API) - サポートされるリクエストフィールド(例:

model/messages/stream等)(要出典: Ollama公式 OpenAI互換API)

運用と安全:ローカルでも“公開範囲”と“投入データ”を決める

結論:ローカルでも「どこまで公開されるか」と「何を投入してよいか」を決めないと、事故(意図せぬ公開・データ持ち出し)につながります。

うっかり公開のリスク(バインド先/ポート/FW)

注意点:

- ローカル専用のつもりでも、設定や共有の仕方次第で外部から到達できる可能性があります

- 社内ネットワーク内での利用でも、公開範囲を明確にしてください

(要出典: Ollamaのホスト設定/OSのFW設定)

社内データ投入の判断(利用条件・リスク)

判断観点:

- モデルの利用条件(ライセンス/規約)を確認する (要出典: 各モデルカード/配布元)

- 入力データの取り扱い(ログ/保存/共有の有無)を把握する (要出典: Ollamaのデータ取り扱いに関する公式情報)

継続運用(更新/削除/定期メンテ)

最低限の運用ルール例:

- 使わないモデルは削除する(ディスク肥大を抑える)

- 更新時は

--helpでコマンド差分を確認する - トラブルが出たら「症状→切り分け」に戻る

参考

- Ollama 公式サイト/ドキュメント (要出典: https://ollama.com/ / https://docs.ollama.com/)

- Homebrew Formulae: ollama (要出典: https://formulae.brew.sh/formula/ollama)

- Ollama OpenAI compatibility (要出典: https://docs.ollama.com/api/openai-compatibility / https://ollama.com/blog/openai-compatibility)

Comments